들어가며

생성형 AI(Generative Artificial Intelligence)는 이용자가 요구한 질문이나 과제를 해결하기 위해 스스로 데이터를 찾아 학습하여 이를 토대로 능동적으로 데이터나 Content 등 결과물을 제시하는 인공지능으로, 방대한 양의 데이터로 사전 훈련되며 파운데이션 모델(Foundation Model, FM)을 기반으로 구동된다. 여기서 FM으로 약칭하는 파운데이션 모델은, 엄청난 양의 데이터를 기반으로 대개 비지도 학습(Unsupervised Learning)으로 훈련된 AI 신경망을 의미한다.

생성형 AI의 Eco-system은?

어떠한 기술에 대한 Eco-system은 여러 측면에서 검토 가능하다. 최종 사용자의 Application이나 Content 종류, Application 개발자 도구 등 다양한 관점에서 Eco-system을 도출하는 방안이 제시 가능한데, 생성형 AI의 경우 그 적용을 다음과 같이 3가지로 조심스럽게 정리한 접근 방안이 존재한다.

Crafting a Cautious Adoption Strategy for Generative AI

- Building external eco-system

- Strengthening Internal Frameworks

- Future of Work Strategy

“Building external eco-system”은 AI 솔루션 제공자와의 협력에 의한 폭 넓은 AI eco-system 형성이며, “Strengthening Internal Frameworks”은 Cross-functional AI 조직 및 Governance, 관련 규정, 전략 등을 의미한다. 이를 기반으로 “Future of Work Strategy”로 본격적인 개발을 위한 투자가 이루어진다.

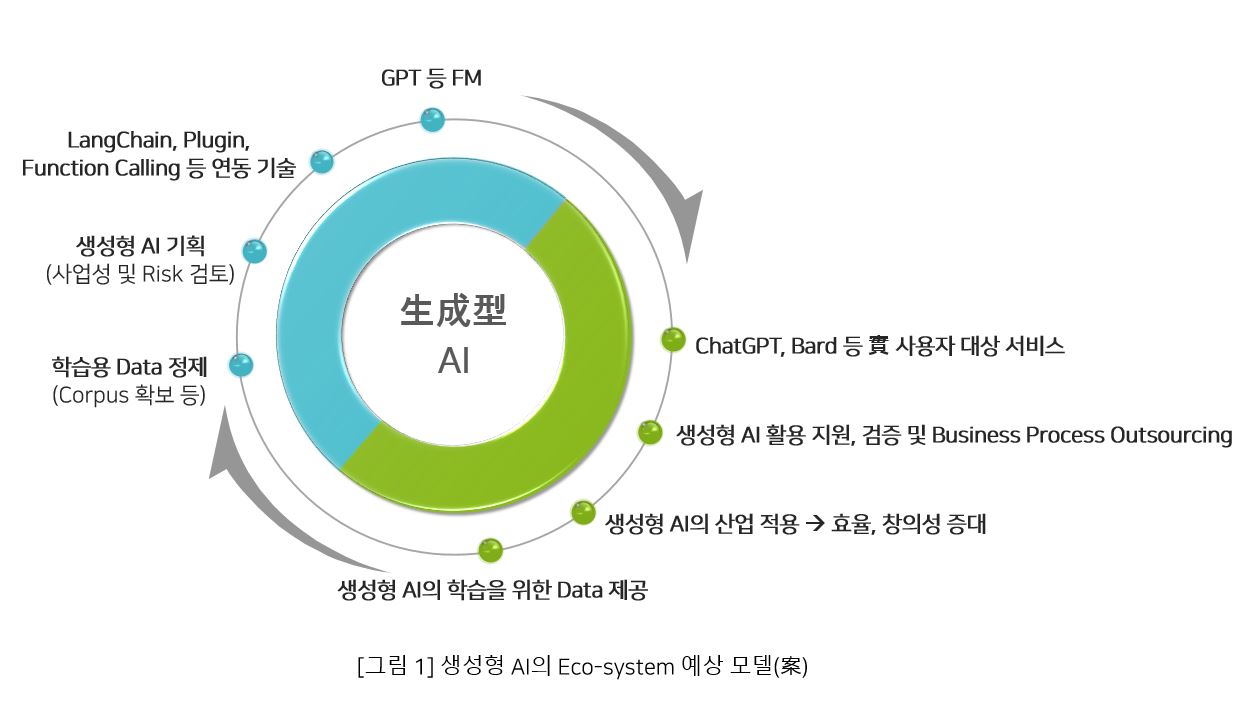

이 외에도 생성형 AI의 Eco-system에 대한 다양한 의견을 종합해 보면, GPT(Generative Pre-trained Transformer) 등 FM(Foundation Model)을 주축으로 하는 생성형 AI의 Value Chain이 순환, 강화의 형태를 나타내지 않을까 하는 전망을 하게 된다.

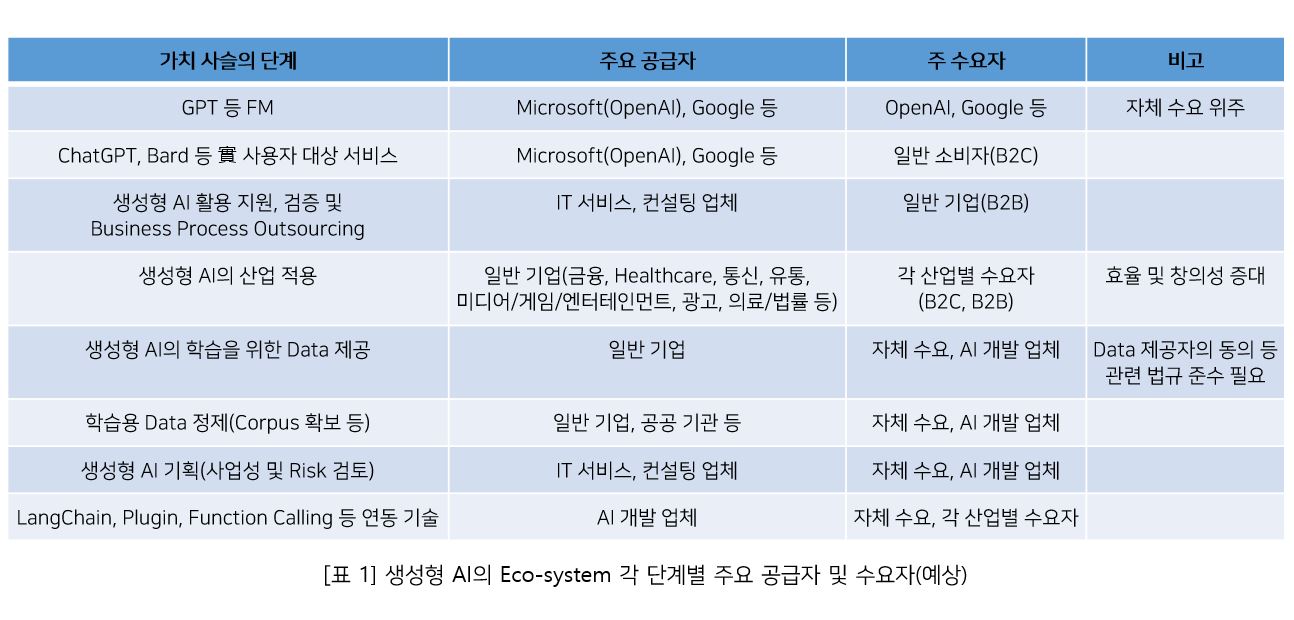

물론 이러한 예상 모델은 기술의 발전에 따라 얼마든지 수정, 보완 가능하다. 다만, 모든 일에는 논의의 대상이 되는 기본 틀이 제공되어야 한다는 점에서 이러한 예상 모델(案)의 제시는 나름의 의미가 부여된다고 생각한다. 이러한 틀 안에서 가치 사슬의 각 단계 별로 예상되는 공급자와 수요자를 정리해 보았다.

생성형 AI의 Eco-system 관련 AI 대체 불가 영역은?

The Ohio State University 내 College of Business의 Hun Lee에 따르면, 사람과 직접적인 Interaction을 하며 물리적으로 존재해야 하거나, 변화하거나 불확실한 상황에서 특별한 Skill을 이용하여 판단을 해야 하거나, 상대방과 공감을 하는 일과 관련을 갖게 되는 경우 AI가 인간의 영역을 대체하기 힘든 Quality의 일이라고 한다.

이를테면, 음악 공연에서 실제 연주자가 관객을 직접 대하는 일을 AI가 대체하는 건 불가능하다. 화재 현장의 소방수나 응급 간호사가 하는 일 역시 현장에서 일어나는 상황을 즉시 판단하고 대처한다는 점에서 AI가 아닌 인간의 영역이다. 심리 상담 또한 사람과 사람 사이의 공감이 필요하다는 점에서 인간의 영역을 벗어나지 않으리라 생각된다.

Eco-system 관련 AI의 한계, 위험 및 관련 규제

1. AI의 한계

AI는 자동화된 데이터 분석으로서 어제 일에 근거하여 오늘 또는 내일을 예측하는 방식이다. 어제 일에 근거하여 오늘이나 내일을 예측함이 별 일 아닌 듯 보일지도 모르나 AI는 엄청난 양의 데이터에 근거하여 상상하지 못할 빠른 속도로 매우 정확한 분석을 가능하게 한다는 걸 많은 사람들이 이미 안다.

AI에 의한 혁신은 경제에도 큰 영향을 미치는데, 당연히 양면성이 존재한다. 이를테면 AI 기반 암 선별 검사의 혜택을 주는 반면 번역이나 회계, 시장 조사 등의 사무직 일자리에 위협을 가하기도 하는데 산업 혁명이나 정보화 혁명을 뛰어넘는, 산업의 대대적인 개편 또는 해체를 불러올지도 모른다.

그런데 이러한 변화는 이미 돌이키지 못한다. 누군가는 이를 알라딘이 지니 요정을 요술 램프에서 이미 꺼내버린 상황에 비유하기도 한다. 아무튼 이로 인해 보안 문제가 발생하기도 하여 군과 정보 기관의 분석 역량을 강화시키기도 한다. 그러나, 중요하게 알아야 할 사항은, 결코 AI가 인간의 정책 결정 기능을 대신하지는 못한다는 사실이다. 정확히는, 대신해서는 안 된다는 주장이라 하겠다. 이와 관련하여서는 미국 등에서 이미 정치적인 논의가 이루어지는 중이다.

2. AI의 위험 요소

생성형 AI는 그 기술의 특성상 엄청난 양의 개인 데이터를 사용함에 따른 정보 보호의 문제와 옳지 않은(특히, Politically Correct하지 않은) 정보를 생성하여 사람들에게 피해를 입힐 우려, 그리고 불공정하거나 기만적인 개인 정보 입수, 활용 및 관리를 할 가능성 등 여러 위험 요소를 배제하지 못한다. 이 중 잘못된 정보의 생성 문제를 “Hallucinations”라고 하며, 정책이나 기술에 의해 이를 해결하고자 하는 노력들이 이루어지는 중이다. 결국 이는 정부 규제로 이어지며, 국가(또는 지역)의 체제 및 문화 특성에 따라 다양한 형태로 나타난다.

3. AI 관련 규제

미국의 경우 AI의 개발, 사용 한계를 결정하는 첫 번째 주체는 정치인보다 법원이 됨이 분명하다. 이는 관련 규제 법안이 통과될 가능성이 매우 낮기 때문인데, 의회의 분열과 기업들의 로비 활동이 힘을 발휘하는 덕분이다. 이러한 상황에서 새로운 기술을 다루는 주된 방식은 소송인데, 선제적인 방지 중심의 EU(European Union)와 달리 미국은 상황에 따라 반응하는 방식으로 접근하는 게 일반이며, 이에 따라 기술 관련 변호사들의 호황이 예상된다.

EU의 AI 관련 법은, 기술의 위험 문제를 완화하기 위해 신뢰할만한 AI 혁신을 지원하는 수단으로, 즉 인공지능에 대한 민주적 통제로 인식되며 생성형 AI도 이에 해당된다. 이러한 상황에서 EU에서는 Open Source AI Model을 중심으로 한 글로벌 개발자 커뮤니티의 영향력이 적지 않을 전망이다. 2022년부터 이들은, 스마트폰에서도 작동하고 다양한 언어를 지원하며 모델 내부에 연구자들이 접근 가능하도록 한 AI 모델을 개발하는 등 AI의 지속 가능성, 포용성, 투명성을 위한 개발에 주력해 왔다.

중국은 최고 사이버 공간 규제 기관에서 중국 기반 사용자에게 제공하는 생성형 AI 서비스 관련 잠정 규칙을 발표하였는데 음란물, 테러리즘부터 인종 차별과 중국 안보 위협 Content까지 많은 항목을 금지하며, 대중의 의견에 영향을 미칠 Algorithm은 관련 기관에 등록해야 한다. 생성형 AI의 서비스 제공자는, 해당 문서를 요구한 자가 특정되지 않는다면 법에 따라 라이선스를 받아야 한다.

Value Chain의 혁신에 따른 기회

결론부터 얘기하면, Eco-system의 전 영역에 걸쳐 기회는 존재한다. 물론, 여기서 얘기한 Eco-system과 Value Chain이 확정적이지는 않지만, 확신하건대 생성형 AI의 전 영역에서 어떠한 기회든 찾아지게 마련이다. 다만, 주의 깊게 살펴볼 기회를 다음의 범주로 정리하고자 하였다. 기업의 혁신 기회 또는 Standalone 사업 기회가 될만한 영역을 3가지로 크게 분류해 보았다.

1. 생성형 AI 활용 지원

많은 사람들이 ChatGPT를 사용한다. 그러나, 모두가 유용한 결과를 쉽게 얻는다고는 장담하지 못한다. 기업의 경우도 마찬가지다. 또한, 이런저런 이유로 생성형 AI를 활용하는 Business Process 전체를 제3자가 Outsourcing하기도 한다. – 제3자라는 표현이 약간 어색하기는 하다. 사용자와 ChatGPT의 양자 관계가 성립하는지는 잘 모르겠다. – 아무튼, 이미 Prompt Engineering, Fine Tuning, RAG(Retrieval Augmented Generation) 등 관련 기술을 별도의 혁신 기회이자 사업 기회로 연결하고자 하는 움직임은 여기저기에서 보인다. 이러한 활용 지원은, 무엇보다 특정 기업에 대한 서비스 의존 비중을 낮추게 해주리라는 효과를 기대해볼 만 하다.

2. AI 산출물 검증 및 AI 생성 여부 인증

기업이 회계감사를 받듯이, AI의 산출물에 대한 검증 및 AI 생성 여부 인증이 필요하다고 판단하여 이를 별도의 서비스로 만드는 방안이다. 회계법인 없이 기업의 역량만으로도 사업보고서 작성이 가능하나 감사인의 감사의견 등이 보고서의 신뢰도를 높인다. 이와 동일한 이유로 AI 관련 검증 및 인증 서비스를 하게 된다. 산출물의 AI 생성 여부 및 출처 등을 밝히는 일은 그러한 서비스를 수행하는 인력, 조직의 신뢰도와 객관성에 근거한다. 인증 서비스는 다양한 영역에서 이루어지는 중이며, 생성형 AI에도 적용될 게 확실한 개념이다. 이미 생성형 AI의 Hallucinations 및 Bias 문제는 다양한 방식으로 해결책을 찾으므로, 결국 누군가의 신뢰도에 근거한 검증 및 인증 서비스 연계가 필요하다.

3. 생성형 AI FM 기획

이미 잘 알려진 GPT 등의 FM이 존재하나 보안 문제나 業의 특성 등으로 인해 모든 기업들이 기존의 FM에만 전적으로 의존할 리는 없다. 앞서 언급한 Prompt Engineering, Fine Tuning, RAG 등 Customization 기술도 유용하나 이들은 기업의 내부 정보가 외부로 유출되지 않도록 하는 보안 기준을 충족한다고 명쾌하게 설명하지는 못한다. Prompt Engineering은 사실상 기존의 LLM(Large Language Model)에 전적으로 의존하고, Fine Tuning도 결국은 기존 모델을 활용하여 일부 업데이트하는 수준이다. RAG의 경우도 외부 데이터를 활용하여 지식을 확장하기는 하나 기존의 모델이 존재해야 한다는 점을 생각하면 보안 문제에 대한 경영진의 우려를 완전히 잠재우기는 어렵다고 본다.

결국 Open Source AI Model에 대한 연구와 혁신 기회 발굴이 필요한 상황이다. 여기서 무엇보다 중요한 일(이자 동시에 어려운 일)은 학습용 데이터의 확보라 하겠다. 대표적으로, Corpus(말뭉치)의 확보 및 학습이 필요한데, 영어의 경우 법학 말뭉치(Corpus Juris Secundum)가 따로 존재하듯이 業의 특성에 따라 별도의 말뭉치를 기획하는 방안도 중요하게 추진할 만 하다.

마치며

생성형 AI는 이용자가 요구한 질문이나 과제를 해결하기 위해 스스로 데이터를 찾아 학습하여 이를 토대로 능동적으로 데이터나 Content 등 결과물을 제시하는 인공지능이고 방대한 양의 데이터로 사전 훈련되며 FM을 기반으로 구동된다고 서두에 언급했다. 이처럼, 기술과 관련된 Eco-system에서 결국 FM이 가장 중요한 요소라는 점에서 처음으로 돌아온 셈이다. 즉, FM과 말뭉치 등의 학습용 Data가 생성형 AI의 핵심 요소이고 이는 Open된 AI Model의 연구 등에 의해 접근 가능하리라 생각한다. 물론, 생성형 AI 산출물 검증 및 AI 생성 여부 인증, AI 활용 지원 등 단기적인 기회에 대해서도 보다 적극적인 검토가 필요할 것이다.

# References

- https://unigramlabs.com/

- https://medium.com/@unigram_labs/the-generative-ai-ecosystem-part-ii-ffdd9407a075

- https://base10.vc/post/generative-ai-mission-critical/

- https://www.sequoiacap.com/article/generative-ai-a-creative-new-world/

- https://aimresearch.co/2023/05/07/unleashing-the-power-of-generative-ai-opportunities-challenges-and-recommendations-for-enterprise-leaders/

- https://www.10tv.com/article/tech/jobs-artificial-intelligence/530-16510c47-ad4e-4ce1-b7f6-2ca792f9ad3e

- https://thehill.com/opinion/congress-blog/4100908-the-qusetions-artificial-intelligence-cannot-answer/

- https://www.ft.com/content/8ce04d67-069b-4c9d-91bf-11649f5adc74

- https://www.technologyreview.com/2023/07/17/1076416/judges-lawsuits-dictate-ai-rules/

- https://fortune.com/2023/07/17/eu-ai-act-democratic-control-artificial-intelligence-open-source-developers-tech-politics-shelley-mckinley/

- https://techcrunch.com/2023/07/13/china-unveils-provisional-rules-for-generative-ai-services/

- https://en.wikipedia.org/wiki/Corpus_Juris_Secundum

최영대 & 김민선 컨설턴트

컨설팅사업부 디지털전략컨설팅팀

최영대 컨설턴트는 5년 이상의 엔지니어 경험과 23년 이상의 경영 컨설턴트 경험을 기반으로 기업, 공공기관 등의 전략과 프로세스 혁신 관련 컨설팅을 수행하고 있으며, 김민선 컨설턴트는 삼성 관계사 및 국내 주요 대기업을 대상으로 R&D 전략, 기준정보 정의 및 ISP(Information Strategy Planning) 컨설팅 프로젝트 경험을 보유하고 있습니다.

Register for Download Contents

- 이메일 주소를 제출해 주시면 콘텐츠를 다운로드 받을 수 있으며, 자동으로 뉴스레터 신청 서비스에 가입됩니다.

- 뉴스레터 서비스 가입 거부 시 콘텐츠 다운로드 서비스가 제한될 수 있습니다.

- 파일 다운로드가 되지 않을 경우 s-core_mktg@samsung.com으로 문의해주십시오.